Τον διάσημο πίνακα του Λεονάρντο ντα Βίντσι, Μόνα Λίζα, «ζωντάνεψαν» ερευνητές της Samsung, χρησιμοποιώντας τεχνητή νοημοσύνη.

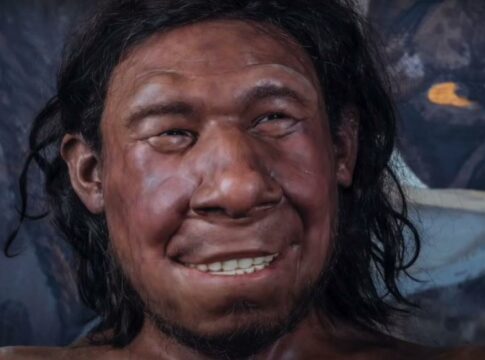

Όπως σημειώνει το BBC, το σχετικό βίντεο, που δημιουργήθηκε από μία φωτογραφία, δείχνει το μοντέλο του πορτρέτου να κινεί το κεφάλι του, τα χέρια, τα μάτια και το στόμα. Πρόκειται για ένα παράδειγμα της αποκαλούμενης «deepfake» τεχνολογίας που προέκυψε από το εργαστήριο ερευνών πάνω στην τεχνητή νοημοσύνη της Samsung στη Μόσχα.

Οι αλγόριθμοι της Samsung εκπαιδεύτηκαν σε μια δημόσια βάση δεδομένων με 7.000 εικόνες διασήμων που είχαν συγκεντρωθεί από το YouTube. To σύστημα, όπως εξηγεί το New Atlas, παίρνει μια σειρά φωτογραφιών ενός προσώπου και τις περνά από ένα «face landmark tracker» για να διαπιστώσει πού είναι τα μάτια, τα φρύδια, η μύτη κλπ. Παράλληλα κάνει το ίδιο με άλλο ένα «driving» βίντεο- πηγή, πηγαίνοντας frame-frame για να παρακολουθεί την κίνηση των χαρακτηριστικών αυτών.

Από εκεί και πέρα, διαφορετικά δίκτυα τεχνητής νοημοσύνης εκπαιδεύονται να κάνουν διαφορετικές δουλειές, χρησιμοποιώντας ένα μεγάλο video dataset από «talking heads», και ακολουθεί η σύνθεση εικόνων- ενώ παράλληλα ένα άλλο δίκτυο προσπαθεί να διακρίνει τα αυθεντικά από αυτά που έχουν δημιουργθεί τεχνητά. Μετά από πολλές δοκιμές, τα δίκτυα αυτά, που λειτουργούν ανταγωνιστικά, βελτιώνονται κατά πολύ, και, όπως γίνεται εύκολα αντιληπτό, το τελικό αποτέλεσμα βελτιώνεται και αυτό.

Αξίζει να σημειωθεί ότι το σύστημα χρησιμοποιήθηκε επίσης για τη δημιουργία βίντεο των Σαλβαντόρ Νταλί, Άλμπερτ Άινσταϊν, Φιοντόρ Ντοστογέφσκι και Μέριλιν Μονρόε.

Σε σχετικό paper όπου περιγράφουν τη δουλειά τους, οι ερευνητές της Samsung κάνουν λόγο για «ρεαλιστικά νευρωνικά talking heads». Το βίντεο προκάλεσε ανάμεικτες αντιδράσεις, και κάποιοι από αυτούς που το είδαν έκαναν λόγο για μια εμπειρία που φέρνει στο νου φουτουριστικές απειλές όπως την τεχνητή νοημοσύνη «SkyNet» του «Εξολοθρευτή».

Υπενθυμίζεται ότι κάτι παρόμοιο είχαν κάνει και ερευνητές του Tel Aviv University το 2017, ενώ ένας ερευνητής είχε φτιάξει, το ίδιο έτος, ένα ψεύτικο βίντεο του Μπαράκ Ομπάμα.