Πέρα από το τι μπορούν να κάνουν οι τεχνητές νοημοσύνες (Α.Ι) και το πώς μπορεί να αντιμετωπίζουν τον άνθρωπο, ένα σημαντικό ζήτημα όσον αφορά στην εξέλιξή τους είναι το ποια θα είναι η στάση τους όταν μία ΑΙ έρχεται αντιμέτωπη με μια άλλη που έχει στόχους που είναι αντικρουόμενοι με τους δικούς της: Θα υπάρχει σύγκρουση ή συνεργασία;

Αυτό ακριβώς είναι το θέμα νέας μελέτης της DeepMind της Google, η οποία δημοσιεύτηκε την Πέμπτη: Όπως αναφέρει το The Verge, οι ερευνητές δοκίμασαν πώς τεχνητές νοημοσύνες αλληλεπιδρούν μεταξύ τους σε μια σειρά από «κοινωνικά διλήμματα». Πρόκειται για καταστάσεις στις οποίες τα άτομα μπορούν να επωφεληθούν εάν δείξουν εγωιστική συμπεριφορά, αλλά στις οποίες όλοι χάνουν εάν όλοι συμπεριφερθούν εγωιστικά. Το πιο γνωστό παράδειγμα είναι το «δίλημμα του φυλακισμένου» (prisoner’s dilemma) όπου δύο άτομα μπορούν να επιλέξουν να προδώσουν το ένα το άλλο για ένα βραβείο, αλλά χάνουν αν και οι δύο κάνουν αυτή την επιλογή.

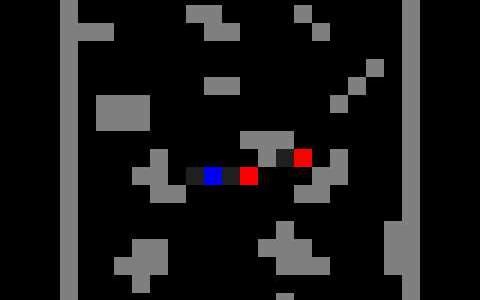

Σύμφωνα με blog post της DeepMind, οι ερευνητές της εταιρείας δοκίμασαν πώς τεχνητές νοημοσύνες θα αντιδρούσαν σε τέτοιες καταστάσεις, βάζοντάς τες σε δύο πολύ απλά βιντεοπαιχνίδια. Στο πρώτο, Gathering, δύο παίκτες πρέπει να μαζέψουν μήλα από μια στοίβα στη μέση.

Έχουν την επιλογή να «μαρκάρουν» τον άλλον παίκτη με μια ακτίνα λέιζερ, βγάζοντάς τον προσωρινά εκτός παιχνιδιού, και αποκτώντας την ευκαιρία να μαζέψουν περισσότερα μήλα. Στο δεύτερο, Wolfpack, δύο παίκτες πρέπει να κυνηγήσουν έναν τρίτο σε ένα περιβάλλον γεμάτο εμπόδια. Πόντοι αποκτώνται όχι μόνο από τον παίκτη που πιάνει το «θήραμα», αλλά από όλους τους παίκτες που βρίσκονται κοντά σε αυτό όταν πιάνεται.

Αυτό που διαπιστώθηκε ήταν ιδιαίτερα ενδιαφέρον: Οι τεχνητές νοημοσύνες άλλαξαν τη συμπεριφορά τους, επιδιδόμενες σε συνεργασία ή σε ανταγωνισμό, ανάλογα με την κατάσταση. Για παράδειγμα, στο Gathering, όταν τα μήλα ήταν πολλά, δεν έμπαιναν στον κόπο να χρησιμοποιήσουν ιδιαίτερα το λέιζερ- αλλά όταν μειώνονταν, η χρήση του αυξανόταν. Ακόμα τα πράγματα έγιναν πιο ενδιαφέροντα όταν μπήκε στο παιχνίδι μια πιο ισχυρή υπολογιστικά τεχνητή νοημοσύνη, η οποία χρησιμοποιούσε το λέιζερ ανεξαρτήτως του πόσα μήλα υπήρχαν: Εν ολίγοις, η πιο έξυπνη Α.Ι αποφάσισε ότι ήταν καλύτερο να είναι επιθετική.

Πάντως, οι ερευνητές θεωρούν πως η αύξηση της χρήσης από την ισχυρότερη τεχνητή νοημοσύνη ίσως να μην ήταν ένδειξη επιθετικότητας, αλλά να σημειώθηκε απλά επειδή η συγκεκριμένη πράξη είναι πιο απαιτητική από υπολογιστικής πλευράς. Ο σκοπός ήταν να στοχεύσει το όπλο στον άλλο παίκτη και να παρακολουθήσει την κίνησή του, δραστηριότητες που χρειάζονται περισσότερη υπολογιστική δύναμη και απαιτούν περισσότερο χρόνο, ο οποίος θα μπορούσε να χρησιμοποιηθεί για τη συλλογή μήλων. Εάν η τεχνητή νοημοσύνη δεν ξέρει αν οι στρατηγικές αυτές θα αποδώσουν, είναι ευκολότερο να συνεργαστεί.

Στην περίπτωση του Wolfpack ωστόσο, όσο πιο έξυπνη ήταν μια τεχνητή νοημοσύνη, τόσο πιο πιθανό ήταν να συνεργαστεί με άλλους παίκτες. Αυτό, όπως εξηγούν οι ερευνητές, συμβαίνει επειδή το να μάθει να συνεργάζεται με τον άλλο παίκτη στο κυνήγι του θηράματος απαιτεί περισσότερη υπολογιστική δύναμη.

Τα αποτελέσματα της έρευνας, οπότε, δείχνουν πως η συμπεριφορά των Α.Ι αλλάζει ανάλογα με τις συνθήκες που αντιμετωπίζουν. Εάν αυτοί επιβραβεύουν την επιθετική συμπεριφορά, η Α.Ι θα είναι πιο επιθετική. Αν αυτοί ανταμείβουν τη συνεργασία, τότε οι Α.Ι θα τείνουν να συνεργάζονται.