Η τεχνολογία deepfake, η οποία επιτρέπει τη δημιουργία σχετικά αληθοφανών βίντεο με «πρωταγωνιστές» διάσημα (και μη) πρόσωπα, θα μπορούσε να προκαλέσει «βίαιες ταραχές» σύμφωνα με ειδικούς.

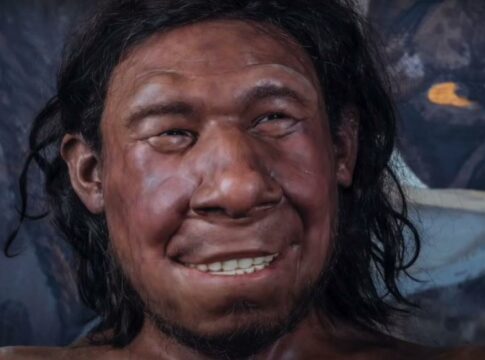

Η εν λόγω τεχνολογία χρησιμοποιεί τεχνητή νοημοσύνη και επιτρέπει τη χρήση εικόνων κάποιου για τη δημιουργία ενός αληθοφανούς βίντεο, όπου ο ίδιος εμφανίζεται να μιλάει ή να προβαίνει σε διάφορες ενέργειες. Τα deepfakes έχουν επανειλημμένα δει το φως της δημοσιότητας, κυρίως λόγω ψεύτικων βίντεο με celebrities.

Όπως αναφέρει το BBC, ο Κλιντ Γουάτς, του Foreign Policy Research Institute, προειδοποιεί ότι υπάρχει κίνδυνος πρόκλησης κοινωνικής αναταραχής εάν η τεχνολογία deepfake χρησιμοποιηθεί από άτομα που δημιουργούν και προωθούν «ψευδείς θεωρίες συνωμοσίας». Σημειώνεται πως η προειδοποίηση αυτή έλαβε χώρα κατά τη διάρκεια ακρόασης στη Βουλή των Αντιπροσώπων των ΗΠΑ σχετικά με τη συγκεκριμένη τεχνολογία.

Η απειλή αυτή εκτιμάται θα μπορούσε να αντιμετωπιστεί εάν τα social media τεθούν προ των ευθυνών τους για την κυκλοφορία τέτοιου είδους παραποιημένων/ ψεύτικων βίντεο.

Η Επιτροπή Πληροφοριών της Βουλής των Αντιπροσώπων κάλεσε μάρτυρες για να καταθέσουν σχετικά με την έκταση των κινδύνων και των δυνατοτήτων που συνεπάγεται η τεχνολογία deepfake. Σημειώνεται πως η ακρόαση αυτή έλαβε χώρα στον απόηχο των επικρίσεων στο Facebook για τη στάση του στο θέμα παραποιημένου βίντεο της Νάνσι Πελόζι, προέδρου της Βουλής των Αντιπροσώπων, αλλά και της ανάρτησης στο Instagram ενός deepfake βίντεο όπου ο Μαρκ Ζάκερμπεργκ εμφανίζεται να «ομολογεί» πως οφείλει την επιτυχία του και τη δύναμή του σε μια μυστική οργάνωση, τη «Spectre».

Κατά την κατάθεσή του ο Γουάτς είπε ότι deepfake λογισμικό τεχνολογίας τεχνητής νοημοσύνης θα μπορούσε να χρησιμοποιηθεί ως ιδιαίτερα αποτελεσματικό όπλο προπαγάνδας.

«Οι χώρες με τις πιο προηγμένες δυνατότητες τεχνητής νοημοσύνης και απεριόριση πρόσβαση σε μεγάλους όγκους δεδομένων θα αποκτήσουν τεράστια πλεονεκτήματα στον πληροφοριακό πόλεμο…η κυκλοφορία deepfakes μπορεί να προκαλέσει κινητοποιήσεις στον πραγματικό κόσμο οι οποίες οφείλονται σε ψευδή προσχήματα, προκαλώντας κρίσεις δημοσίας ασφαλείας και πυροδοτώντας εξάρσεις βίας» σχολίασε σχετικά, υποδεικνύοντας ως παράδειγμα τα περιστατικά βίας στην Ινδία που οφείλονταν στην κυκλοφορία θεωριών συνωμοσίας/ fake news. «Η εξάπλωση των δυνατοτήτων deepfakes απλά θα αυξήσει τη συχνότητα και την ένταση αυτών των ξεσπασμάτων βίας».

Παρεμφερείς προειδοποιήσεις απηύθυναν και άλλοι ειδικοί, όπως η καθηγήτρια Ντανιέλ Σιτρόν, ειδική σε νομικά θέματα, του University of Maryland. Σύμφωνα με την ίδια, τα deepfakes χρησιμοποιούνται ήδη ως πολιτικό εργαλείο- μάλιστα ανέφερε την περίπτωση της δημοσιογράφου Ράνα Αγιούμπ η οποία τον Απρίλιο του 2018 έγινε στόχος παρενόχλησης και εκφοβισμού εξαιτίας της δημιουργίας deepfake βίντεο σεξουαλικού περιεχομένου με την ίδια.

Η Σιτρόν τόνισε πως ίσως θα έπρεπε να επανεξεταστεί η αμερικανική νομοθεσία όσον αφορά στην ασυλία των πλατφορμών κοινωνικής δικτύωσης ως προς το περιεχόμενο που ανεβάζουν οι χρήστες. «Θα έπρεπε να θεσπίσουμε όρους όσον αφορά στη νομική ασυλία, προκειμένου να βασίζεται σε λογικές πρακτικές περιεχομένου» είπε σχετικά.